Archiv der Kategorie: Gitarre

Anti Effect Pedal

?

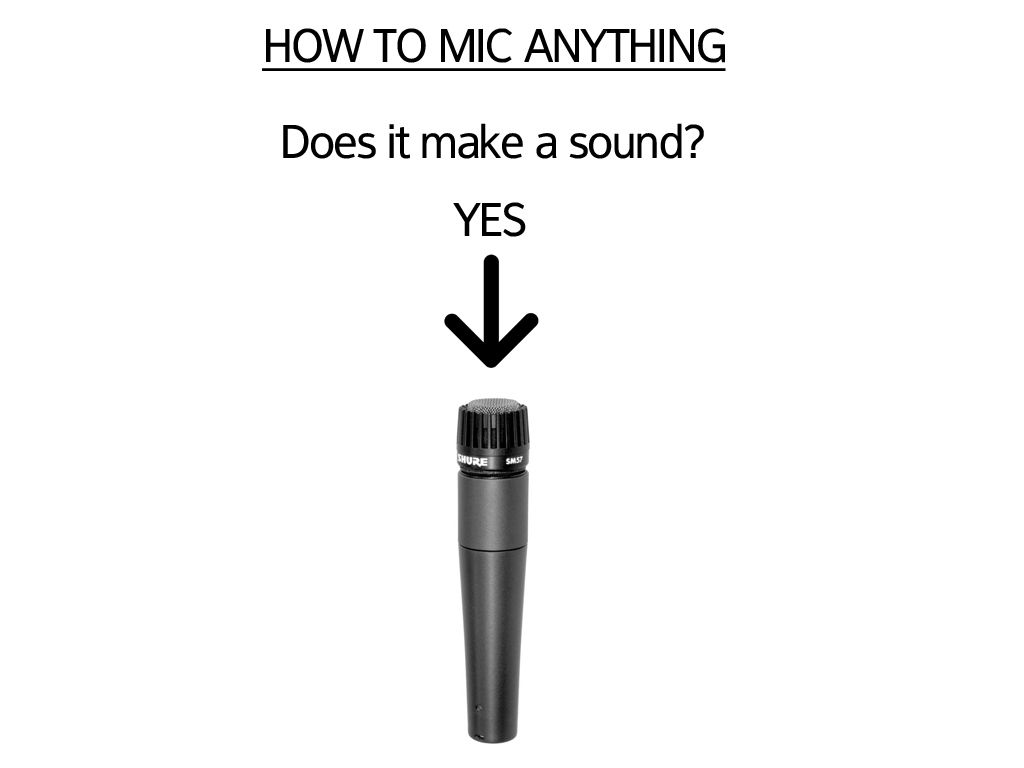

Mikrofonierung eines E-Gitarren Speakers

Ohne jetzt mal viel dazu zu schreiben oder zu erklären: ich habe neulich ein Video entdeckt, was sehr anschaulich zeigt, wie die Mikrofonpositionierung und -ausrichtung den Klang beeinflusst. Natürlich gibt es noch viele, viele weitere Variablen, die den Sound verändern, aber der “Grundcharakter” der verschiedenen Mikrofonierungsarten kommt hier schon gut rüber:

5 Wege um Tiefe im Mix zu erzeugen

Wie kann man es schaffen, in einem (Live-)Mix eine Tiefenstaffelung zu erzeugen? Es soll vielleicht nicht immer alles im Vordergrund stehen, geht ja auch gar nicht. Im folgenden mal einige (altbekannte oder auch andere) Techniken, die man benutzen kann, um nicht nur das Panning, sondern auch Tiefe zu nutzen, um den Mix zu staffeln und zu sortieren. Dadurch werden die einzelnen Elemente besser ort- und hörbar und die Transparenz der Abmischung wird verbessert.

LAUTSTÄRKE

Faustregel natürlich: je lauter, desto weiter vorne. Hier sollte man mal anfangen. Allerdings gilt das natürlich nur begrenzt: ein lautes dumpfes Signal wirkt unter Umständen doch weiter hinten als ein kristallklares, aber leiseres.

DYNAMIK

Klar, Kompression und Parallelkompression presst einem den Sound direkt ins Ohr. Wunderbar geeignet um kritische Sounds nach vorne zu holen – und dort festzukleben. Allerdings hat das ja nun wenig mit Tiefe zu tun. Vielleicht tut es manchen Klängen ja auch ganz gut mal zwischendurch wieder im Mix abzutauchen um nur bei bestimmten Tonhöhen oder einer bestimmten Intensität nach vorne zu kommen. Ist jedenfalls bewegter und mehr 3D. Ganz besonders nett kann man das natürlich mit dem Hall kombinieren. Richtig klasse kann es kommen, wenn man zum Beispiel weitestgehend unkomprimierte Vocals zum Hall schickt (und richtig komprimierte Vocals weiter zur Summe). Dadurch bekommt die Stimme einen wunderbar dynamischen Schein. Klingt je nachdem voll 80er oder richtig teuer. Oder beides. Hat man die Möglichkeit, einen Transientendesigner/-shaper zu nutzen, so kann man auch damit experimentieren: je mehr Attack desto fokussierte und weiter vorne, je weniger Attack desto verschwommen und eher im Hintergrund.

EQ

Klappt live natürlich besonders gut: der Mix bleibt transparent, man hat keine Probleme mit Feedbacks und alles zumatschenden Hallfahnen und es klingt sogar “natürlich”: je weiter ein Instrument im Hintergrund stehen soll, desto weniger Höhen bekommt es. Es lohnt sich, damit mal die Gitarren vom Gesang zu trennen, oder Teile des Schlagzeugs (z.B. die Toms) nach hinten zu stellen. Live hat man natürlich außerdem den Vorteil, dass dadurch gefühlt weniger Becken im Mix sind.

HALL

Ganz klar, der Klassiker. Mit nur einem Hallgerät kann man schon eine Menge 3D erzeugen. Faustregel natürlich: je mehr Hall=desto weiter weg. Allerdings sollte man hier (besonders) live eher nach Gehör und Gefühl gehen, als nach einer naturgetreuen Abbildung der Bühne oder eines imaginären Raums zu streben. Soll die Snare wirklich mehr Hall haben als der Gesang nur weil sie weiter hinten ist? Je nach Stil, Song und gewünschter Atmosphäre dürfen hier ruhig mal Regeln gebrochen oder neu erfunden werden. Fast noch wichtiger als die Ausklingzeit: das Predelay. Hier unbedingt mit herumexperimentieren. Falls man es kann oder möchte (und das KISS-Prinzip vernachlässigt), auch gerne verschiedene Hallgeräte benutzen.

DELAYS

Sind natürlich wirklich fummelig einzustellen, aber das ist ja die eigentlich Definition von Tiefe: Entfernung. Wenn die Snare 5 Meter weiter weg vom Hörer als der Gesang ist – warum sollten dann beide Signale gleichzeitig aus den Speakern kommen? Aber Vorsicht: da man die Signale ja mit Kanaldelays direkt beim Reinkommen ins Pult verzögert werden dadurch eventuell Monitormixe für den Künstler komisch klingen. Sofern man also kein Delay in den Bussen anlegen kann, könnte man sich bestimmte Signale per soft-patching auf andere Kanäle legen, die man dann verzögert und nur zur Summe schickt (aber nicht zu den Monitoren). Auch sollte man natürlich nicht allzu kreativ mit Delays werden, ohne das mit dem Künstler abzusprechen :)

Gibt es noch andere Möglichkeiten?

Mixing with the Attack Principle

Bin gerade mal über ein Video gestolpert, was ich vor einiger Zeit entdeckt habe.

Schaut mal rein.

Das Prinzip lässt sich natürlich auch hervorragend live umsetzen. Dabei kann man natürlich die “Attack” auch in etwas längeren Zeitabschnitten denken. Ich benutze es zum Beispiel sehr gerne für Vocals oder für (längere, oder im Hintergrund passierende) Solo-Teile, allerdings lässt sich so auch klasse die Aufmerksamkeit auf subtilere Parts (wie z.B. Percussion) lenken. Der Vorteil ist natürlich, dass die Zuhörer live auch Zuschauer sind. Sie sehen die Akteure und die Instrumente. So funktioniert das Prinzip live fast noch besser: sobald der Fokus auf ein Instrument gelenkt ist, kann man ja sehen, was dort passiert. So muss man es unter Umständen noch weniger hören. Es lohnt sich in jedem Fall hiermit mal zu experimentieren. Welche zusätzlichen Abwandlungen dieses Prinzips könnte man live nutzen?